Experten-Blog

Selbstlernende Roboter – die matrixfähige Montagezelle

Vor fast 100 Jahren sagte Henry Ford: „Sie können einen Ford in jeder Farbe haben, Hauptsache er ist schwarz.“ – ein Satz, der in die Geschichte einging. In unserer heutigen Zeit ist die Vorstellung, ein Auto nicht vollständig personalisieren zu können, undenkbar. Ebenso wie das damit verbundene Produktionsparadigma. Personalisierte und auf die Kundenwünsche zugeschnittene Produkte, wie Kleidung oder Handyhüllen gehören für uns längst zum Standard, ebenso wie das individuell auf unsere Bedürfnisse gefertigte Auto. Doch was bedeutet dieser Wunsch nach Individualität unserer Produkte für deren eigentliche Herstellung?

Stellen Sie sich vor, wir wollen ein neues Produkt industriell fertigen. Dabei geht es im Grunde nicht einmal unbedingt darum, welches Produkt wir eigentlich herstellen wollen. Der Einfachheit denken wir an ein simples Produkt, bestehend aus zwei Platten, die wir aufeinanderlegen und miteinander verschrauben wollen. Das klingt doch erst einmal ziemlich einfach oder? Auch unsere Mitarbeiter in der Produktion sehen das so und machen sich frisch ans Werk. Allerdings ist gerade dieser, sich immer wiederholende Prozess nach einiger Zeit für den Menschen zu einfach und kognitiv wenig anspruchsvoll. Die Lösung: Ein Roboter, der diesen Prozess und die repetitiven Aufgaben übernimmt und mit wenig manuellem Aufwand eingerichtet werden kann.

Doch die personalisierten und auf die Kundinnen und Kunden zugeschnittenen Produkte stellen für unseren Roboter eine Herausforderung dar: Im Gegensatz zu unserem erfahrenen Mitarbeiter weiß unser metallener Kollege nicht, wie er damit umgehen soll, dass die Produkte ständig wechseln und sich verändern. Wie bringen wir also unserem Roboter bei, gerade mit dieser Vielfalt an unterschiedlichen Produkten umzugehen, zumal wir aktuell ja nur zwei Platten miteinander verschrauben wollen? Wie soll das schlussendlich für komplexere Produkte funktionieren?

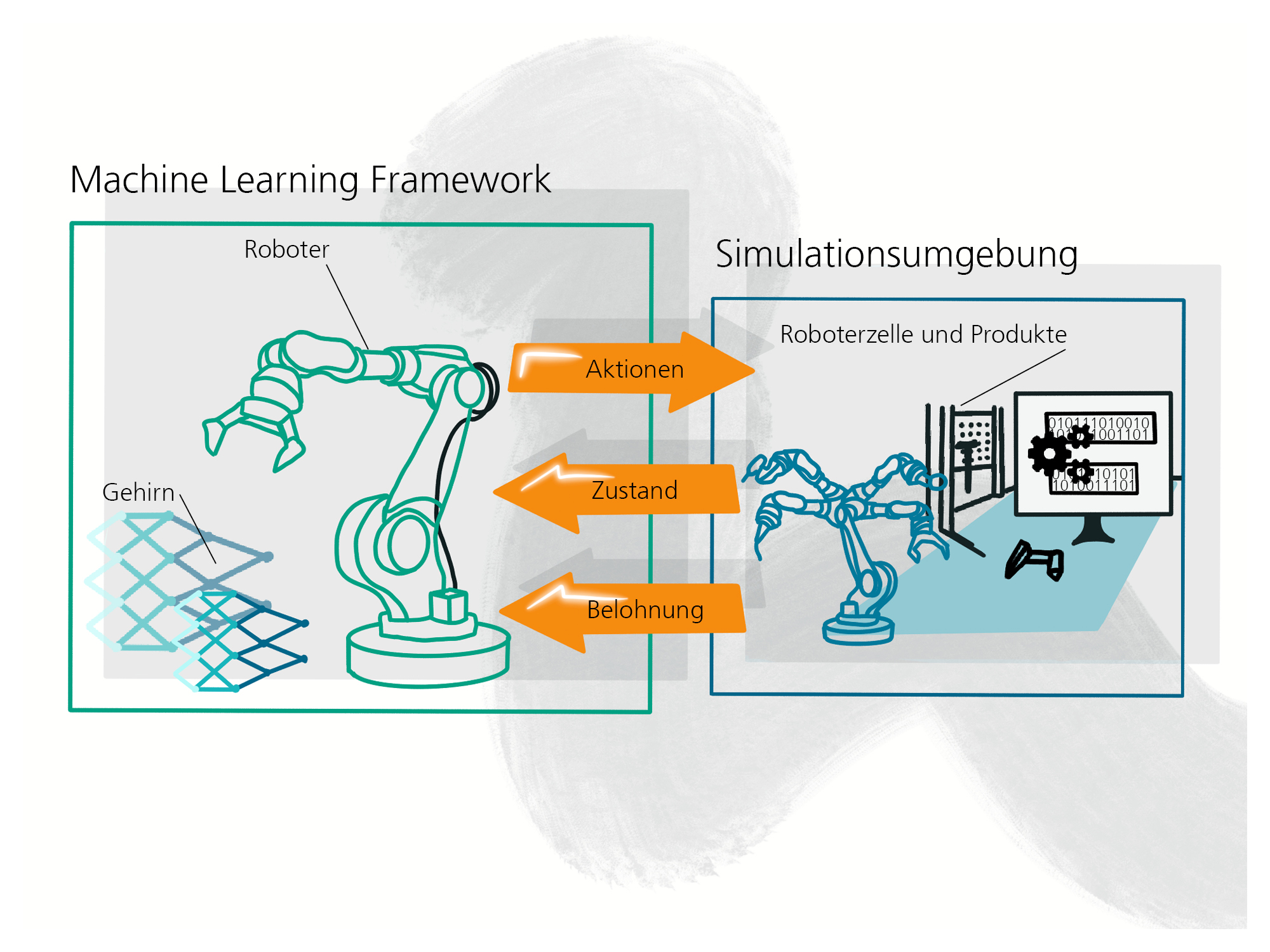

Eine Möglichkeit wäre, dass der Mitarbeiter dem Roboter wieder und wieder zeigt, wie er das Produkt herstellen soll, selbst, wenn wir alle Bedürfnisse unserer Kunden im Hinblick auf unsere Produktvarianten berücksichtigen wollen. Klingt doch erstmal vernünftig: Der Roboter wird durch den Menschen trainiert und profitiert von dessen Erfahrung. Damit wären allerdings sowohl unser Roboter als auch der Mensch gleichzeitig gebunden. Viel schöner wäre doch also die Vorstellung, dass sich der Roboter selbst beibringt unser Produkt zu fertigen, ein bisschen wie ein kleines Kind, das lernt Klötzchen unterschiedlicher Formen in das dazu passende Loch zu werfen. Die passende Technologie dazu nennt sich Deep Reinforcement Learning und ist ein Teilgebiet der Künstlichen Intelligenz (KI). Wie das kleine Kind führt unser Roboter Aktionen aus und beobachtet das Ergebnis. Anfangs wird unser Roboter vermutlich noch versuchen, den kreisförmigen Klotz in das viereckige Loch zu werfen. Damit unser Roboter also wirklich lernt, müssen wir ihm eine Rückmeldung geben, ob seine Aktionen auch wirklich zum Ziel führen. Das geschieht über eine sogenannte „Belohnung“. Führt unser Roboter die richtige Aktion aus, erhält er eine Belohnung, andernfalls eine Bestrafung, beispielsweise, wenn er den Klotz beschädigt. Doch wie soll das dann in der Realität und vor allem in einer industriellen Fertigung funktionieren, wenn der Roboter unser Produkt beschädigen kann? Glücklicherweise gibt es auch dafür eine Lösung: die Simulation. Nun übt unser Roboter in einer sicheren, digitalen Umgebung, wie er unser Produkt herstellen kann und beschädigt nicht mehr als ein paar Bits und Bytes. Damit wird unserem Roboter sogar ermöglicht mehr zu lernen, als nur unser einfaches Produkt herzustellen, denn in der Simulation können wir ohne viel Aufwand nahezu jedes beliebige Objekt einfügen. Wichtig ist dabei, dass unser Roboter, während er lernt, auch nur die Aktionen benutzt, die er später auch in der Realität zur Verfügung hat. Das wird durch die Verwendung von etablierten Roboteraktionen, sogenannten „Skills“ sichergestellt, die unabhängig vom Typ unseres Roboters eingesetzt werden können. Solche Roboter-Skills werden bereits heute für eine Vielzahl an Prozessen, von einfachen Verschraubungen bis hin zu komplexen Montageoperationen eingesetzt.

Insgesamt liefert uns unser Roboter damit eine Möglichkeit, auf Kundenwünsche zu reagieren und individualisierte Produkte zu montieren. Durch das Wissen über seine eigenen Aktionen interagiert der Roboter mit seiner Umgebung. Jede Aktion wird dabei im Hinblick auf den Gesamtfortschritt durch eine Belohnung oder Bestrafung bewertet. Wir geben unserem Roboter damit die Fähigkeit zur sequenziellen Entscheidungsfindung und damit zum situativen Handeln mit einem längerfristigen Ziel. Zudem lernt unser Roboter sicher mit Produktvarianten und sogar Abweichungen in den Produkten oder im Prozess umzugehen, indem diese während des Trainings berücksichtigt werden. Zeigen wir unserem Roboter also während des Training nicht nur ein Produkt, sondern auch dessen Varianten wird der Roboter lernen damit umzugehen und auch die Produktvariante herstellen zu können. Schlussendlich durchläuft unser Roboter einen ähnlichen Prozess wie der Mensch, wenn er die Montageanleitung liest und sich anschließend am zu fertigenden Produkt versucht. Durch sich wiederholenden Versuche und Irrtümer lernen sowohl der Mensch als auch der Roboter kontinuierlich dazu, bis sie irgendwann die richtige Montagetechnik gefunden haben. Und da unser Roboter nur in der digitalen Welt trainiert, ist er vollkommen sicher – sowohl für sich als auch seine Umwelt.

Vielleicht haben ja auch Sie ein Produkt, das sich unser Roboter einmal anschauen sollte und lernen könnte zu montieren. In jedem Fall geben wir unseren Robotern ein gutes Stück Eigenständigkeit und gehen damit einen wichtigen Schritt in Richtung kognitive Robotik.

Ihr Arik Lämmle

Dieses Forschungs- und Entwicklungsprojekt wird durch das Bundesministerium für Bildung und Forschung (BMBF) gefördert (Förderkennzeichen: L1FHG42421). Die Verantwortung für den Inhalt dieser Veröffentlichung liegt bei den Autor:innen.

Fraunhofer-Verbund Produktion

Fraunhofer-Verbund Produktion